A empresa de identidade de máquinas Venafi lançou um modelo proprietário de IA generativa (gen-AI) para ajudar no gigantesco, complexo e crescente problema de gerenciamento de identidades de máquinas.

A OpenAI liderou o uso em larga escala de gen-AI em aplicativos com o lançamento do ChatGPT. Gen-AI permite que as pessoas usem IA; mas também está aberto ao uso indevido e ao abuso. Os usuários rapidamente passam a confiar – talvez até demais – nas respostas ou instruções fornecidas pelos modelos de geração de IA. Assim, embora a inclusão da gen-AI tenha se tornado essencial tanto para fins de desempenho como de marketing, é fundamental fazê-lo com cuidado.

Venafi Atena é lançado com três focos principais: para equipes de segurança, para desenvolvedores e para a comunidade. Dois estão disponíveis agora, um estará disponível em 2024 e há uma promessa de mais por vir.

Athena para equipes de segurança já está disponível. “É tudo uma questão de tomar decisões; tornando o Venafi mais fácil, mais acessível e mais rápido de usar”, explicou Kevin Bocek, vice-presidente de ecossistema e comunidade da Venafi. “Trouxemos uma interface sofisticada de chatbot para o plano de controle. Costumava ser necessário um especialista em Venafl e identidades de máquina para fazer as perguntas certas, mas agora posso pedir a Athena orientação de configuração passo a passo a partir de qualquer ponto de partida e posso até perguntar quanto tempo isso levará.

O segundo foco é o Athena para desenvolvedores. Ele reverte o problema de fazer com que o pessoal de segurança trabalhe com equipes de desenvolvimento, disponibilizando o conhecimento e os requisitos de segurança aos desenvolvedores sob demanda. Estará disponível em 2024, mas um protótipo foi demonstrado no Venafi Machine Identity Summit em Las Vegas.

“Isto não é para pessoal de segurança; é muito para os engenheiros”, disse Bocek. “Como desenvolvedor, poderei gerar código muito específico para o problema que pretendo resolver, a linguagem que desejo usar e os tipos de identidade de máquina com os quais preciso trabalhar. Posso pegar esse código generativo e implantá-lo em teste ou produção com o plano de controle Venafi. Não é apenas gerar o código; também fornece a capacidade de mover esse código para produção.”

Athena para a comunidade é o novo laboratório experimental de Venafi. “Estamos lançando um projeto totalmente novo que redefine completamente os relatórios e as respostas para problemas de gerenciamento de identidade de máquinas. Isso está disponível hoje com exemplos de código e dados com recursos pré-identificados para aprendizado de máquina no GitHub e no Hugging Face”, afirmou a empresa. (Hugging Face se descreve como ‘A plataforma onde a comunidade de aprendizado de máquina colabora em modelos, conjuntos de dados e aplicativos’.) “Venafi agora oferece um laboratório experimental para fornecer acesso antecipado a recursos inovadores de IA generativa e dados de identidade de máquina”, ele acrescenta.

“Assim como o GitHub é para engenheiros, o Hugging Face é o centro para especialistas em IA e aprendizado de máquina”, disse Bocek. “Estaremos lançando dois projetos. Um, por exemplo, é chamado de Vikram (em homenagem ao Vikram da mitologia indiana) Explorer. Posso perguntar ao Vikram: quais são os cinco certificados que expirarão mais cedo? E Vikram responderá isso para mim. Posso pedir ao Vikram para representar visualmente certos problemas, por exemplo, digamos que eu queira saber a tendência na emissão de certificados. Ou quais são os principais aplicativos usados para automação?”

É bastante inovador e experimental, acrescentou ele, “porque combina bancos de dados na memória com código generativo. Na verdade, não se trata de enviar seus dados para um grande modelo de linguagem – na verdade, trata-se de obter o código que analisará seus dados e, em seguida, executá-lo na memória.”

Este último ponto é importante. Demonstra a consciência e as preocupações de Venafi sobre as novas ameaças que a IA pode introduzir ao tentar resolver as ameaças de segurança tradicionais existentes. Ao expor os planos do seu projeto à comunidade de código aberto, a Venafi espera detectar e resolver essas ameaças.

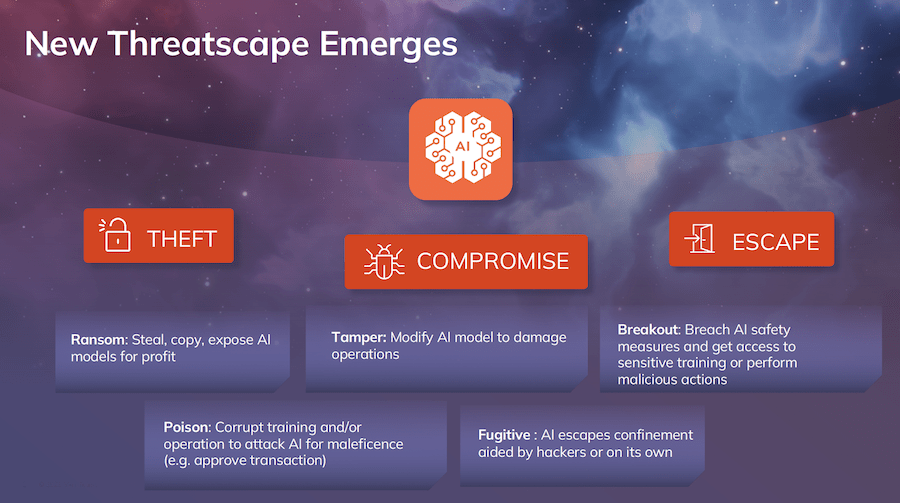

Em sua própria apresentação no Venafi Machine Identity Summit, a empresa resume o cenário de ameaças de IA abrangendo roubo, comprometimento e fuga de dados.

Roubo e comprometimento podem resultar do envenenamento de dados. Escape está violando barreiras de proteção embutidas por meio de consultas projetadas para forçar a IA a fornecer respostas que de outra forma seriam proibidas.

A isto podemos acrescentar a questão da privacidade. Os modelos Gen-AI podem reter e usar os dados que recebem em suas consultas – disponibilizando esses dados a terceiros. A abordagem do Vikram Explorer resolve isso nunca enviando dados diretamente ao modelo gen-AI – tornando o roubo de dados de consulta, se não impossível, pelo menos significativamente mais difícil.

“O gerenciamento de identidades de máquinas é complexo e desafiador, especialmente à medida que avançamos em direção a um futuro nativo da nuvem”, afirma Shivajee Samdarshi, CPO da Venafi. “As empresas modernas exigem uma maneira rápida, fácil e integrada de lidar com esses problemas complexos de gerenciamento de identidades de máquinas. O poder da IA generativa e do aprendizado de máquina torna isso possível hoje.”

Saiba mais na SecurityWeek’s IA cibernética e automação Shummitar

Participe deste evento virtual enquanto exploramos o entusiasmo e a promessa em torno das soluções de segurança baseadas em IA nas empresas e as ameaças representadas pelo uso adversário da IA.

6 de dezembro de 2023 | Evento Virtual